Qu'attendre de l'Intelligence Artificielle, en temps de crise et après ?

L ’IA va-t-elle ici ‘changer la donne’ dans la découverte d’un vaccin contre la Covid-19 ?

Comme dans d’autres industries, l’IA, et plus précisément dans sa génération actuelle le Machine Learning/Deep Learning (ML/DL), fait l’objet d’annonces de presse retentissantes.

S’il est encore trop tôt pour se prononcer dans le cas de la pandémie, tentons de prendre un peu de recul, pour essayer d’analyser l’impact de l’IA en entreprise, en situation ‘normale’ ou de crise.Pour cela, deux exemples de situations, plus ou moins critiques.

24 AOUT 2012 : LE JOUR OÙ AMAZON NOUS A PROMIS DE NOUS LIVRER AVANT MÊME QUE NOUS Y PENSIONS

Cette utilisation de l’IA n’est pas que de l’ordre de la pure science fiction, puisque Amazon a déjà déposé un brevet relatif à l’achat prédictif[1]. La proposition de valeur du commerçant changerait ainsi radicalement, de la traditionnelle Commande/Livraison à une pré Livraison/Achat.

Ce cas d’usage repose sur l’apport clé du ML/DL, à savoir la capacité à reconnaitre corrélations entre données numérisées.

Ceci permet, en termes « grand public », de repérer des patterns (patrons) - au sens de la couture, à savoir une ligne directrice réutilisable - dans le cas d’Amazon, le besoin de produits en fonction d’un historique d’achat, de caractéristiques de produits et d’autres variables identifiées à partir de la base client d’Amazon.

Et ceci peut se décliner en de nouvelles possibilités de diagnostic, de prédiction de futures actions ou de futurs états. Cette capacité nouvelle à générer de la « prédiction fiable » est le changement clé qu’apporte le ML/DL dans les entreprises.

Les conséquences sont doubles.

D’un côté, mieux prédire aide à mieux prendre les décisions.

De l’autre, toute activité basée sur la prédiction, que cette activité soit elle même très prédictible ou basée sur un ‘savoir faire’ technique, implicite ou explicite, est susceptible d’être remplacée par un algorithme prédictif d’IA, pour une partie plus ou moins significative.

À commencer par les travaux physiques en environnement « stable », avec des robots ayant « appris » à répéter les actions d’un travailleur humain. Puis les activités centrées sur l’acquisition et le traitement d’informations - qu’il s’agisse des réponses en ligne d’un site Internet ou de la phase de diagnostic d’un artisan[2].

De nouveaux entrants utilisant nativement l’IA, ou des concurrents la déployant massivement, pourraient devenir de réelles menaces pour les entreprises, qui doivent donc effectuer un travail de réflexion stratégique classique sur l’éventuel avantage compétitif qu’apporterait une prédiction fiable ou le handicap si elle n’est pas utilisée.

La question suivante, encore plus médiatisée, est de savoir si l’IA va « décider à la place de l’homme » ? Une deuxième mise en situation pour aider à nuancer le propos.

26 SEPTEMBRE 1983 : LE JOUR OÙ DES MISSILES NUCLÉAIRES AMÉRICAINS ONT ÉTÉ LANCÉS SUR L’URSS

Une date où donc l’humanité est potentiellement passée très près d’une guerre nucléaire.

En effet le centre de défense stratégique antimissiles soviétique a reçu ce jour là d’un satellite de surveillance avancée au dessus des USA une alerte, confirmée à 100%, relative au lancement de missiles intercontinentaux. Les tensions étaient alors très fortes entre les USA et l’URSS[3] et une telle menace d’attaque imminente aurait dû entrainer la riposte quasi automatique de l’URSS.

Mais le Colonel de garde Stanislav Petrov a jugé qu’il ne fallait rien transmettre à sa hiérarchie, car, d’après lui, il s’agissait d’une erreur technique. Ce qui a été effectivement confirmé ultérieurement.

Que nous révèle cette crise?

Que prédiction n’équivaut pas à discernement et jugement.

Ceci vaut aussi dans le cas de l’IA. En effet, l’apprentissage ML/DL est dépendant de la qualité et de la profondeur des données avec lesquelles il s’effectue[4].

De plus les données digitales ne reflètent pas facilement les informations qualitatives et subjectives, notamment celles liées à la culture de l’organisation et de ses valeurs.

Enfin, et plus fondamentalement, l’IA reconnait des patterns et prédit uniquement en fonction d’un objectif clair qui lui est donné. Les objectifs multiples, difficiles à décrire ou sujets à interprétation, ne sont pas atteignables par l’IA aujourd’hui[5].

Au total le jugement humain reste nécessaire vis à vis des prédictions de l’IA.

Notamment dans les situations sans précédent certain - par exemple d’émergence de l’innovation- ou les situations demandant de l’intelligence émotionnelle et contextuelle, en face d’un client ou d’un usager - un cas classique étant la finalisation et la communication d’un diagnostic médical à un patient.

IA, « prédiction fiable » et jugement humain: Quelles conséquences pour les entreprises ?

D’un côté, les activités avec une forte composante relationnelle, comme gérer et développer des collaborateurs ou gérer les parties prenantes - équipiers, clients, usagers -, ne seront pas prise en charge par l’IA, tant qu’elle n’intégrera pas le non-dit, le culturel et l’affectif dans sa prédiction. De même pour les travaux physiques et manuels en environnement « ouvert » (de type espace public, naturel ou chantier) - non prédéfini et changeant

De l’autre, l’IA rend la prédiction plus accessible à de nombreuses fonctions dans l’entreprise et la décentralise.

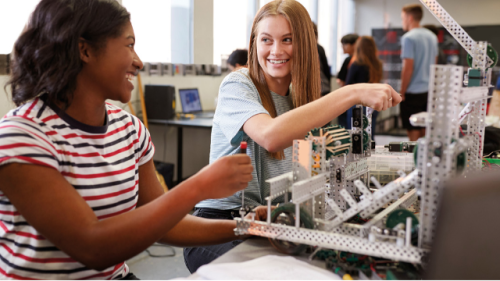

Les besoins en capacités de discernement et de jugement vont alors se trouver renforcés à tous les niveaux de l’entreprise. L’enjeu est de pouvoir définir les bons objectifs pour l’IA, de savoir en interpréter les résultats et d’en contrôler la pertinence.

Enfin un outil d’IA peut se retrouver hors des conditions d’utilisation pour lesquelles il a été initialisé.

Dans ce cas, il faut pouvoir « reprendre la main ». De ce point de vue, déléguer entièrement à l’outil les décisions au quotidien risque une perte de compétences dangereuse en cas de crise[6].

En conclusion, le déploiement de l’IA aura bien un impact majeur pour toute activité basée sur la prédiction, y compris, pour revenir à notre question de départ, en situation de crise.

Cela étant, la capacité de discernement et de jugement du décideur restera clé, pour « peser » la décision et, si nécessaire, « reprendre la main ».

Références

[1] US 8615473 - ‘Method and system for anticipatory package shipping’, brevet délivré en Décembre 2013,

[2] Notons que cela ne signifie pas, et de loin, la disparition du poste de travail. Car il y a quasi ment toujours d’autres activités non substituables (dont les interactions avec les collègues, des collaborateurs, les clients ou les usagers). Et que l’étude d’impact économique, au delà de la faisabilité technique, peut identifier des coûts de migration élevés, une moindre attractivité coûts/performance de la technologie, et des barrières fortes, légales, sociétales et culturelles, à la mise en œuvre de l’outil IA.

[3] Un avion de la Korean Airlines avait été abattu trois semaines auparavant par des chasseurs soviétiques.

[4] Dans la crise USA/URSS, les données du satellite d’alerte n’étaient pas croisées avec les données de satellites géostationnaires, ce qui aurait mis en évidence un cas rare de réflection de rayons solaires à travers des nuages à haute altitude, ce que le satellite de surveillance a confondu avec des traces de missile.

[5] Dans la crise USA/URSS, au delà de l’objectif « reconnaitre un éclat de lumière cohérent avec la trajectoire d’un missile », Petrov avait d’autres objectifs , comme « cohérence avec ce qui est connu de la doctrine militaire d’attaque des USA » (nombre de missiles détectés) ou « fiabilité estimée du système de détection ».

[6] À titre extrême d’illustration, la perte de compétences en matière de pilotage manuel a été identifiée comme étant dramatique lors du crash du vol Air France 447 Rio de Janeiro Paris, lorsque les sondes et systèmes ont commencé à envoyer des informations erronées.

Philippe GINIER-GILLET

est consultant et accompagne les dirigeants lors de leur prises de décision stratégique en environnement complexe. Il est aussi depuis dix ans Professeur associé en Innovation & Entrepreneuriat à l’Ecole Polytechnique.

Formations: Telécom Paris et London Business School

Auteur

Sales & management of Consulting services

• Studies of emerging markets, Due diligence of start-ups

• Strategic consultancy to innovative SMBs and BUs

• Management of Change & Organisational transformation within Large Enterprises

A Know-How blending four distinctive fields of expertise

• Advisor to CEOs on decision making in complex environments

• Conference speaker, Seminars facilitator

• International Management of business lines, based 10 years in London, UK and Los Angeles, USA

• Adjunct Professor - Technological entrepreneurship & innovation, Ecole Polytechnique [The leading science & technology graduate university in France for 200 years]

My Convictions as a practitioner of innovation

• Never underestimate a market unwillingness to adopt an innovation.

• Innovation with a big I does not exist. Drivers of innovation do. Which driver to leverage from is a strategic choice.

• Innovation creates first Fears Uncertainties and Doubts rather than opportunities.

• The most influent processes to manage innovation are those owned by the Finance and HR Departments.

• The weakest link in innovation management is often the Product Management function.

• “Best innovation practices” must be adapted to the realities and specificities of each organization.

• Creation of competitive advantages. Alignment with corporate strategy. Two key issues to do with innovation strategy but not so easily addressed by many firms.

• The acid test of an innovation strategy is not the first but the second generation of products & services. Because innovation is sustainable – thanks to capabilities built over time..

• Three guiding principles to manage the Fuzzy Front End of innovation

- Think not in silos but collaborative and transverse : “It takes an orchestra to play a symphony”

- Back and forth from strategic thinking to operational testing: “The devil is in the details”

- Start with multi functional & business perspectives: “To a hammer, every problem is a nail problem” Voir les 2 Voir les autres publications de l’auteur(trice)